Os criadores repetem: “Eu nunca consenti neste scraping.” Do lado de lá, os engenheiros respondem: “Estava público, e é assim que a Web funciona.” O que fica é uma reacção tecnológica em cadeia, com as duas partes a sentirem-se lesadas - e sem consenso total sobre onde termina uma coisa e começa a outra.

Vi uma fotógrafa abrir o portátil num café cheio, escrever o próprio nome num chatbot e esperar, só para ver. O modelo descreveu “o estilo dela” com uma precisão inquietante e, de seguida, sugeriu prompts para o replicar - ambiente, iluminação, distância focal - como se fosse uma mistura de especiarias. Ela fixou o ecrã e depois olhou para a janela, onde uma bicicleta de entregas passou, silenciosa, como uma sombra. Parecia que a Web tinha mudado discretamente as fechaduras. Murmurou, quase para si: “Eu não disse que sim.” O ruído do café continuou. Quem é que pode dizer que não?

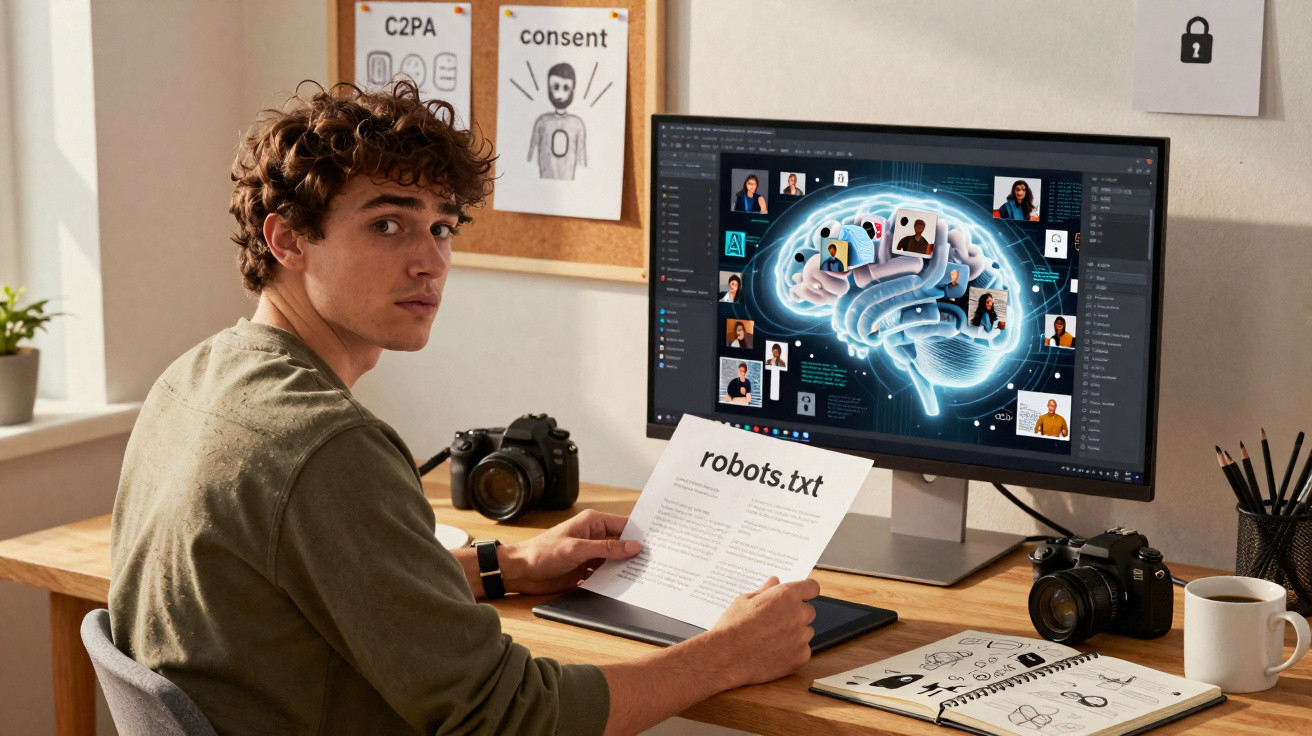

O scraping que se ouviu pela Web

O conflito é fácil de resumir e difícil de viver: para os criadores, treinar com publicações, fotografias, código e artigos sem autorização soa a exploração; para os programadores, é aprendizagem legítima a partir de conteúdos públicos. Há verdade nas duas narrativas. E ambas tendem a ignorar a pequena dor de ver o teu melhor trabalho transformado em matéria-prima. Quase todos já sentimos isso: o instante em que algo que fizeste deixa de parecer teu e começa a parecer de toda a gente. E esse sentimento fica.

Os exemplos acumulam-se como separadores que nunca fechaste. Romancistas avançaram com acções colectivas por causa de conjuntos de dados cheios de livros seus. Um gigante da fotografia de stock processou depois de encontrar a sua marca de água a aparecer como um fantasma em imagens geradas. Redacções começaram a vedar os sites, ajustando robots.txt e metatags, e acabaram a assinar acordos que parecem muito com renda. Quem programa reconhece o padrão de anos de scraping em pesquisa e redes sociais: páginas públicas viram um bem comum - até alguém monetizar o portão. A diferença, agora, é a escala: não são dez páginas, são milhares de milhões.

No fundo, está uma tensão antiga: acesso versus consentimento. Um URL público é, tecnicamente, acessível; mas aceder e reutilizar não são a mesma coisa. Os termos de serviço tentam marcar fronteiras, os direitos de autor tentam proteger a expressão, e o uso legítimo abre um porto de abrigo que muda consoante o caso. O robots.txt diz aos crawlers por onde não devem passar, mas é etiqueta, não é lei. Se a Web é uma cidade, o scraping é tráfego - e o tráfego torna-se um caos quando as ruas nunca foram feitas para camiões TIR. É por isso que todos acabam a falar uns por cima dos outros.

Como reagir, construir melhor e manter a alma intacta

Começa pelos comandos que ainda tens na mão. Coloca sinais explícitos de “sem treino de IA” nos cabeçalhos das páginas e nos ficheiros robots, e mantém uma lista actualizada de crawlers de IA para bloquear. Usa credenciais de conteúdo, como C2PA, para assinalar imagens e artigos com proveniência verificável e resistente a adulterações. Reserva os ficheiros em resolução total para compradores ou membros e, nas páginas abertas, publica apenas pré-visualizações mais pequenas. Não vai travar tudo, mas obriga o outro lado a tomar decisões. E essa fricção conta.

Pensa por camadas, não à procura de uma bala de prata. Junta vedações técnicas a linguagem jurídica nos teus termos e reforça ambos com um guião de comunidade: quando detectares uso indevido, regista provas, escala o problema e actua em conjunto. Não sacrifiques o teu público só para contrariar um scraper. Reduz o que tiveres de reduzir e depois aposta no que não se “raspa” com facilidade - acesso, eventos, contexto de bastidores, relações com patronos. Sejamos francos: ninguém faz isto tudo, todos os dias. Por isso, escolhe dois hábitos que consigas manter daqui a seis meses, e não doze que vais largar em seis semanas.

Os criadores não são os únicos a ficar com o problema; quem constrói também pode desenhar para o consentimento. Monta conjuntos de dados documentados, licenciados e auditáveis, e trata as opções de exclusão como o mínimo - não como o máximo. Modelos treinados com confiança vão mais longe do que modelos treinados em lacunas.

“Não podemos construir o futuro com conteúdo que as pessoas se arrependem de ter partilhado.”

- Adiciona directivas meta explícitas “noai”/“noimageai” e bloqueia crawlers de IA comuns (por exemplo, GPTBot, Google-Extended) no robots.txt.

- Adopta as Credenciais de Conteúdo C2PA para que os teus ficheiros transportem dados de origem verificáveis para onde quer que vão.

- Coloca os activos de maior valor atrás de contas ou chaves de API, com limites de taxa e registos.

- Publica uma página de política simples com os teus termos de treino e licenciamento em linguagem clara.

O debate que ninguém ganha ao “ganhar”

Há dias em que esta disputa parece uma discussão sobre quem é dono do pôr do sol. A Web foi feita de pessoas a publicar, ligar e remisturar em público - e depois as máquinas aprenderam mais depressa do que antecipámos. Se os criadores vencerem cada centímetro, arriscamos uma internet fragmentada, com paywalls altos e conversas pequenas. Se os programadores vencerem cada centímetro, arriscamos uma cultura esgotada e um público que deixa de partilhar. A única saída que escala é consentimento à velocidade da rede: sinais que signifiquem algo, acordos que pareçam dinheiro a sério, modelos que assumam de onde aprenderam, e comunidades capazes de dizer não sem desaparecer. A próxima fase da IA não será decidida só por um tribunal. Vai ser decidida pelo que escolhermos publicar amanhã.

| Ponto-chave | Detalhe | Interesse para o leitor |

|---|---|---|

| Consentimento vs. uso legítimo | O acesso público não é uma autorização geral; o uso legítimo é um teste caso a caso, ancorado no propósito, na quantidade e no impacto no mercado. | Perceber onde está, de facto, a tua margem de manobra legal e moral. |

| Sinais que contam | Robots.txt, metatags “noai” e C2PA criam intenção detectável e aplicável quando combinados com política e registos. | Transformar frustração em acções que alteram o comportamento de quem faz scraping. |

| O licenciamento voltou | De acordos com meios noticiosos a mercados de datasets, dinheiro e transparência estão a entrar nos pipelines de treino. | Identificar novas vias de receita em vez de fechar tudo. |

Perguntas frequentes:

- O scraping por IA é ilegal? Depende do que é extraído, de como é utilizado e do país onde estás. Copiar expressão pode activar limites de direitos de autor, enquanto a extracção de factos costuma cair numa zona mais cinzenta, moldada por uso legítimo ou por excepções de mineração de texto e dados.

- Como posso impedir que modelos treinem com o meu site? Usa o robots.txt para bloquear crawlers de IA conhecidos, adiciona metatags “noai/noimageai”, aplica marca de água e credenciais aos ficheiros e coloca os activos de maior valor atrás de contas ou APIs com limites de taxa.

- E a minha arte que já está dentro de um modelo? Podes reunir e documentar evidência, juntar-te a acções colectivas, negociar remoções ou exclusões quando existirem, e procurar aconselhamento sobre vias como marca registada, direitos de personalidade/figura pública ou direitos de autor - conforme o teu caso.

- O robots.txt e as metatags têm força legal? Sinalizam intenção e ajudam a formar normas e contratos. Ignorá-los pode sustentar alegações relacionadas com intrusão ou termos, sobretudo quando o acesso exigiu contornar controlos explícitos.

- As empresas de IA vão pagar aos criadores? Estão a surgir acordos com editores, titulares de direitos musicais e bibliotecas de imagens. A pressão está a empurrar para licenciamento e partilha de receitas. Quanto mais sinais claros e padronizados os criadores utilizarem, mais depressa esses mercados se consolidam.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário