Uma IA, treinada com exames ao cérebro, está a transformar pensamentos silenciosos em palavras que se conseguem ler num ecrã. Não é magia nem telepatia, mas o efeito provoca o mesmo choque discreto: significado privado, tornado público.

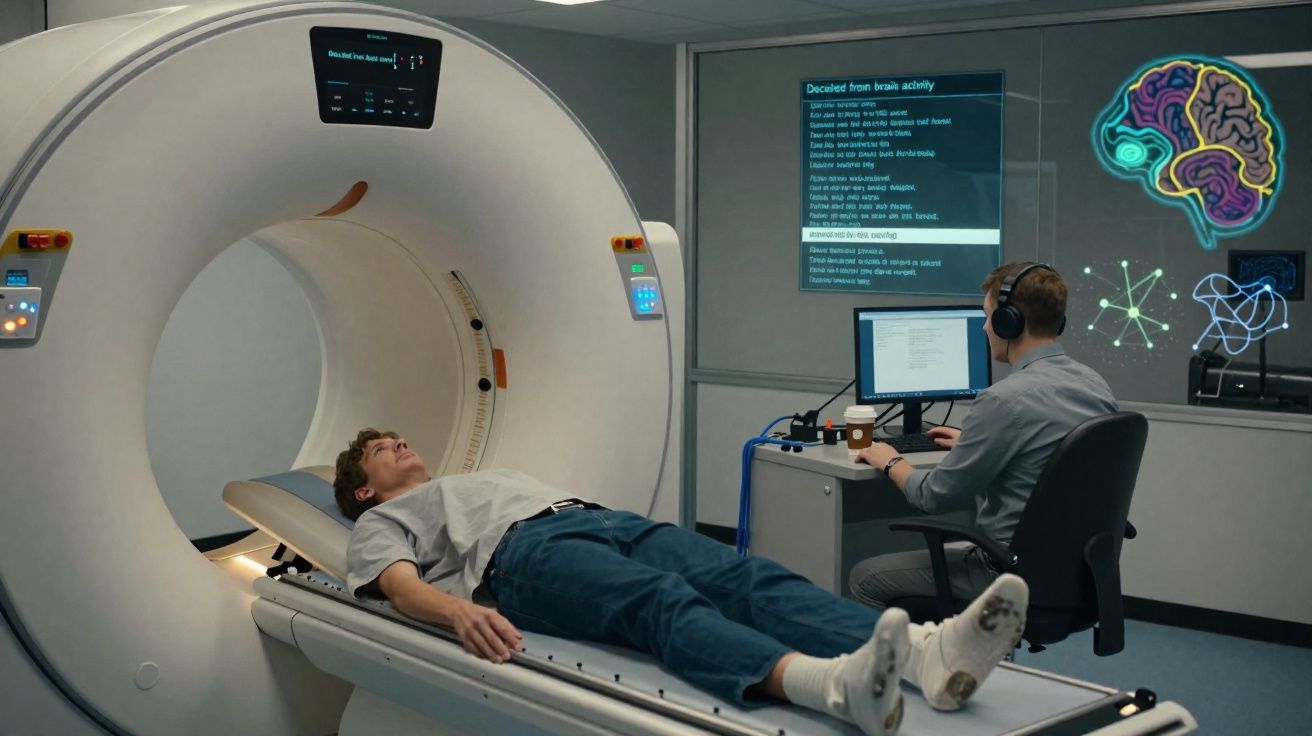

O voluntário permanece imóvel, aconchegado dentro da “concha” de uma máquina de fMRI, enquanto uma história toca nos auscultadores. O aparelho bate com um ruído surdo, como um tambor lento. Numa sala ao lado, um investigador bebe café frio e observa um texto que vai surgindo em tempo real - frases estranhamente familiares, quase inquietantes - captadas não da boca, mas de padrões de sangue e oxigénio a circular pelo cérebro. A transcrição não é perfeita. É um esboço do sentido, uma paráfrase, um quase-acerto que, ainda assim, atinge o alvo. Sente-se a pessoa dentro das frases, a sua voz sem som. E depois aparece uma linha que ninguém estava à espera.

De exames ao cérebro a frases: o que passou a ser possível

A IA já consegue associar certos padrões de actividade cerebral à linguagem, o suficiente para produzir texto legível e relevante a partir de exames não invasivos. Pense nisto como um tradutor que fala “cérebro”. Não soletra cada palavra que lhe passa pela cabeça, mas consegue reconstruir a ideia geral de histórias que ouve, de cenas que imagina e, por vezes, do contorno do seu monólogo interior. O segredo está em combinar horas de exames cerebrais de uma pessoa com um modelo de linguagem que aprendeu como as ideias tendem a encadear-se. O sistema não lê mentes; descodifica padrões que a pessoa partilha activamente. Essa diferença muda tudo.

Num cenário muito falado, voluntários passam bastante tempo num scanner de fMRI a ouvir podcasts longos ou a imaginar que estão a contar uma história. A IA vai aprendendo as “impressões digitais” neurais dessa pessoa para palavras, expressões e temas. Mais tarde, quando o mesmo voluntário ouve um excerto novo, o modelo prevê texto que acompanha o significado - mais próximo de um resumo do que de uma citação. A precisão varia, mas o resultado capta frequentemente quem fez o quê e porquê, sem copiar frases exactas. É como quando um amigo termina a nossa frase antes de a dizermos. Só que, aqui, o “amigo” é um modelo treinado com os ritmos do seu cérebro.

Por trás do pano, isto funciona porque a linguagem vive em padrões distribuídos, e não num único “ponto” isolado. A fMRI mede alterações no fluxo sanguíneo - um indicador indireto e lento da actividade cerebral - em milhares de locais. O descodificador aprende como esses padrões se alinham com o espaço latente de um grande modelo de linguagem: esse mundo estatístico onde “cão” e “trela” aparecem próximos, onde as histórias têm arco e o contexto manda. É esse alinhamento entre os dois espaços que faz a magia parecer real. E sim: o treino é específico de cada pessoa. Sem a sua colaboração, o seu descodificador fica mudo.

Como a IA e a fMRI funcionam na vida real - e onde tudo falha

Para visualizar, imagine dois parceiros a aprender uma dança. Primeiro, ensina a IA a sua coreografia: horas suas a ouvir ou a imaginar enquanto o scanner regista. Depois vem o dueto. Da próxima vez que o seu cérebro desenha um padrão semelhante - porque está a ouvir uma narrativa ou a visualizar uma cena - o modelo prevê a frase que melhor encaixa. Em geral acerta no tom e, por vezes, apanha um pormenor tão pessoal que parece íntimo. Funciona melhor com histórias do que com pensamentos soltos e erráticos. O ruído mental aleatório não se traduz bem.

Há pontos fracos recorrentes. A fMRI é lenta e ruidosa, e o sinal é “nebuloso” quando comparado com os fogos-de-artifício de milissegundos dos neurónios reais. Isso obriga a IA a apoiar-se no contexto para preencher lacunas, o que por vezes descamba para erros ditos com demasiada confiança. Além disso, as pessoas não são iguais - a metáfora do seu cérebro pode ser a distração do meu. E sejamos francos: ninguém faz isto no dia a dia. Pode ser preciso mais do que uma sessão para obter um descodificador pessoal estável e, mesmo assim, ele pode falhar com números ditos depressa, nomes próprios ou sintaxe do tipo “código”. O modelo percebe a forma da linguagem; adivinha os pormenores.

A privacidade está no centro desta história, não na margem. A ciência actual indica que são necessários consentimento e treino; caso contrário, o descodificador corre mal e falha de forma evidente. É um alívio - e, ainda assim, o futuro avança. Um investigador disse-me que a fronteira certa é simples:

“O consentimento é a nova firewall dos seus pensamentos.”

- Descodificadores não invasivos precisam de horas dos seus próprios dados para funcionarem.

- Os resultados soam a paráfrases e resumos, não a citações palavra por palavra.

- Tem dificuldade com listas, números e palavras isoladas sem contexto.

- Ética e trilhos de auditoria importam tanto como o tamanho do modelo.

O que isto significa para o resto de nós

Um sistema que converte actividade cerebral em palavras é uma porta - e as portas não escolhem para que lado se abrem. De um lado: esperança. Pessoas que perderam a fala por doença ou lesão podem recuperar uma comunicação rápida e conversacional sem cirurgia. Escritores poderiam rascunhar ao imaginar cenas. Terapeutas poderiam, um dia, escutar o “não dito” com consentimento. Do outro lado: controlo. Quem detém o seu descodificador? Como é protegido? O consentimento é a nova firewall dos seus pensamentos. As leis ficam para trás, e as normas sociais também. A tecnologia não vai esperar por regras perfeitas - e é nessa tensão que vivemos agora.

| Ponto-chave | Detalhe | Interesse para o leitor |

|---|---|---|

| Descodificação não invasiva | Modelos baseados em fMRI conseguem parafrasear fala percebida ou imaginada | Mostra o que passou a ser possível sem implantes |

| O treino é pessoal | Cada descodificador precisa de horas dos seus próprios dados cerebrais | Explica porque “ler a mente” de desconhecidos não é uma realidade |

| Privacidade por desenho | Consentimento e armazenamento seguro são barreiras essenciais | Ajuda a ponderar riscos e a fazer as perguntas certas |

Perguntas frequentes

- Isto é mesmo leitura de mentes? Não no sentido da ficção científica. A IA aprende o mapeamento entre cérebro e linguagem em sessões cooperativas e depois prevê paráfrases. Sem os seus dados de treino e sem a sua participação, o sistema desfaz-se.

- Quão exacto é o texto gerado? Suficientemente bom para captar temas, intenções e uma estrutura frásica aproximada, mas não cada palavra. É mais forte com narrativas e mais fraco com nomes isolados, números ou conteúdo parecido com código.

- Que tecnologia é usada? Regra geral, fMRI para exames não invasivos, combinada com descodificadores neurais ligados a grandes modelos de linguagem. Alguns laboratórios também exploram EEG, MEG e eléctrodos invasivos para sinais mais rápidos e detalhados.

- Isto pode funcionar em casa? Hoje, não propriamente. A fMRI é equipamento de nível hospitalar. Existe EEG de consumo, mas o sinal é muito mais ruidoso. Opções portáteis como fNIRS estão a surgir, mas ainda são iniciais e com largura de banda limitada.

- E quanto à privacidade e ao consentimento? Os descodificadores actuais são específicos de cada pessoa e exigem a sua cooperação activa. As questões difíceis são armazenamento, acessos e garantias legais. Esteja atento a registos de auditoria, revogação de consentimento e jurisdição.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário