Por trás do ecrã, está a acontecer algo muito menos glamoroso.

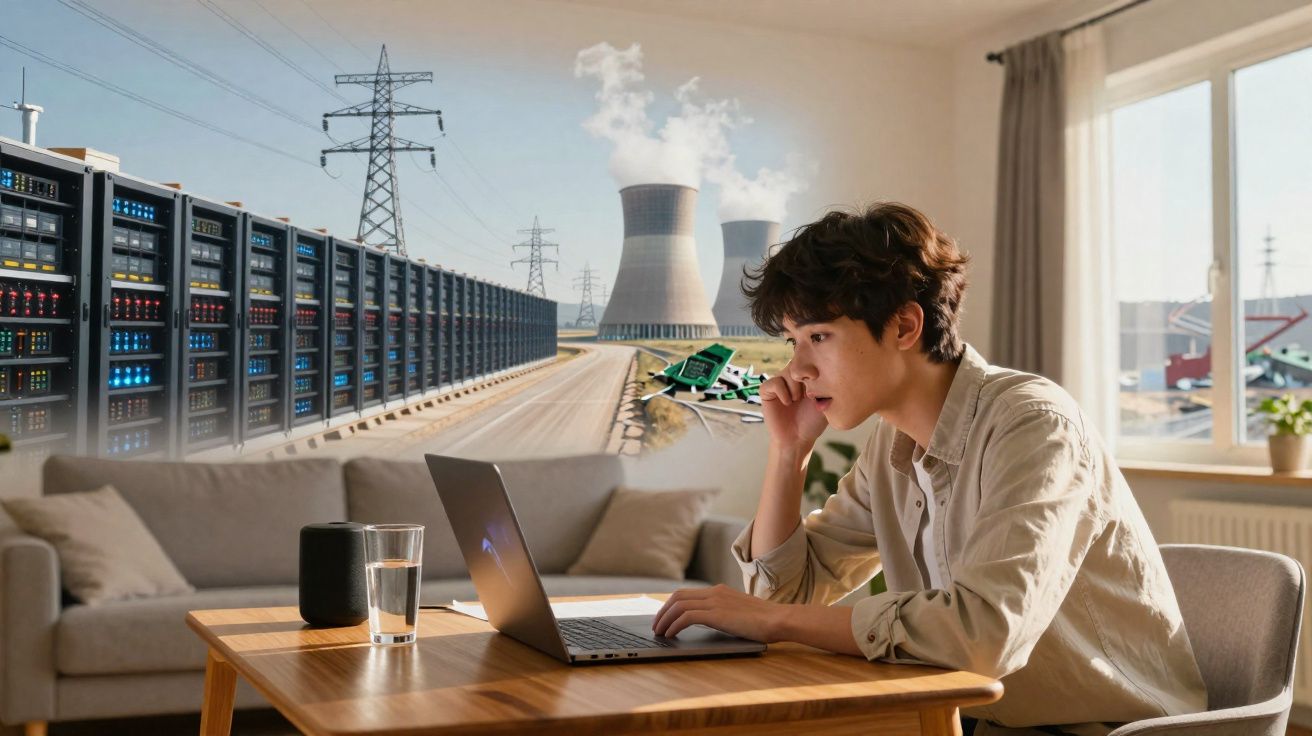

A inteligência artificial parece leve e etérea: um robô conversacional num navegador, uma funcionalidade no telemóvel, um botão na aplicação de correio electrónico. No entanto, cada pedido de IA depende de enormes centros de dados, chips especializados e fluxos gigantescos de eletricidade e água. Investigadores do MIT alertam agora que esta infraestrutura invisível pode alterar o uso global de energia e de recursos muito mais depressa do que reguladores e planeadores esperam.

A pegada oculta da IA começa pela energia

A primeira coisa que a IA consome é eletricidade. E não pouca: falamos de quantidades à escala da rede eléctrica, medidas em megawatts e terawatts-hora.

Treinar um modelo generativo moderno significa executar milhares de milhões de cálculos, repetidamente, em chips muito potentes. Depois de o modelo entrar em funcionamento, a fase de inferência - ou seja, todas as perguntas quotidianas que os utilizadores fazem - mantém esses chips em atividade contínua.

Os centros de dados em todo o mundo consumiram cerca de 460 terawatts-hora de eletricidade em 2022, aproximadamente o mesmo que o consumo anual total de França, e esse valor deverá mais do que duplicar até 2026.

Só na América do Norte, a procura de energia dos centros de dados passou de 2 688 megawatts no fim de 2022 para 5 341 megawatts um ano depois. A IA não é o único fator por trás desta subida, mas é já a principal razão pela qual estão a ser propostos novos centros de servidores nos Estados Unidos, na Irlanda, nos Países Baixos e noutros países.

A carga não é constante. As execuções de treino criam picos bruscos de consumo que os operadores das redes têm de antecipar. Quando a produção renovável é baixa, esses picos podem obrigar as empresas de eletricidade a ligar centrais a gás ou mesmo geradores a gasóleo, aumentando as emissões precisamente no momento em que o setor tecnológico afirma estar a tornar-se mais sustentável.

Uma pergunta à IA versus uma pesquisa na rede

Para quem usa estes sistemas, pedir algo a um robô conversacional parece pouco diferente de fazer uma pesquisa no Google. A fatura energética conta outra história.

Estima-se que um pedido médio ao estilo do ChatGPT consuma cerca de cinco vezes mais eletricidade do que uma pesquisa convencional na rede.

À medida que os modelos crescem em dimensão e capacidade, precisam de ainda mais computação para gerar cada resposta. Isso faz com que o impacto climático dependa fortemente da velocidade a que o sistema energético se descarboniza - e de saber se a procura da IA vai ultrapassar a oferta limpa.

A água: o outro recurso que a IA esgota

A eletricidade é apenas metade do problema. Manter dezenas de milhares de chips arrefecidos cria uma sede enorme por água.

A maioria dos grandes centros de dados utiliza sistemas de arrefecimento à base de água. Essa água pode vir de redes municipais, rios, lagos ou aquíferos. Cada quilowatt-hora consumido por um centro de dados típico está associado a um uso significativo de água, desde as torres de arrefecimento no local até à água necessária a montante para as centrais elétricas.

Os investigadores estimam que o funcionamento de um centro de dados pode consumir cerca de dois litros de água por cada quilowatt-hora de eletricidade consumido.

Em regiões com escassez hídrica ou ecossistemas sob pressão, isto coloca difíceis compromissos entre o crescimento digital e as necessidades locais. Um único novo campus com elevada carga de IA numa zona seca pode competir com a agricultura ou com as habitações pelo mesmo recurso limitado.

Onde a IA e a seca colidem

Países como a Espanha, os Estados Unidos e várias zonas da Índia já enfrentam ondas de calor e níveis em queda nos reservatórios. Instalar grandes centros de dados de IA nestas regiões pode intensificar a pressão, sobretudo no verão, quando o ar condicionado e o arrefecimento dos servidores atingem o máximo.

- As temperaturas elevadas implicam mais arrefecimento e, por isso, maior consumo de água.

- As secas reduzem a água superficial disponível, empurrando os operadores para a extração de águas subterrâneas.

- Os ecossistemas locais podem ser prejudicados quando rios e aquíferos são explorados mais depressa do que conseguem recuperar.

Em Portugal e noutros países mediterrânicos, este debate ganha peso adicional porque os períodos prolongados de calor e a variabilidade da precipitação tornam a gestão da água ainda mais sensível. Quando o licenciamento de novos centros de dados é avaliado, a disponibilidade hídrica e a capacidade da rede eléctrica deveriam ser tratadas como condições centrais, e não como detalhes secundários.

O hardware por trás das emissões da IA

Para além das operações do dia a dia, as máquinas que alimentam a IA têm o seu próprio custo ambiental. A fabricação de servidores e, em especial, de chips de alto desempenho, exige muitos recursos e está concentrada em poucos países.

As unidades de processamento gráfico, ou GPUs, são as ferramentas de trabalho da IA moderna. Foram concebidas para cálculo paralelo e deixam as unidades centrais de processamento tradicionais para trás quando se trata de treinar redes neuronais.

Estima-se que a Nvidia, a AMD e a Intel tenham vendido cerca de 3,85 milhões de GPUs para centros de dados em 2023, um aumento acentuado face aos 2,67 milhões de 2022, sendo provável que 2024 tenha sido ainda mais elevado.

Cada GPU envolve mineração e processamento de metais, fabrico complexo de semicondutores e transporte global. Em comparação com processadores convencionais, os chips de topo para IA são maiores, mais complexos e mais exigentes em termos energéticos para produzir, o que aumenta a sua pegada carbónica incorporada antes mesmo de chegarem a um bastidor.

Das minas às fábricas de semicondutores e aos resíduos electrónicos

A história do hardware de IA vai desde o cobre e os metais raros extraídos do subsolo até às fábricas de semicondutores intensivas em químicos e, por fim, aos resíduos electrónicos.

Os riscos de poluição surgem em cada etapa:

| Fase | Impactos principais |

|---|---|

| Mineração | Destruição de habitats, rejeitados mineiros, contaminação da água, elevado consumo de energia |

| Fabrico de chips | Produtos químicos tóxicos, gases com efeito de estufa usados na gravação, grande procura de água e eletricidade |

| Montagem e transporte | Emissões da logística, resíduos de embalagens |

| Fim de vida | Resíduos electrónicos, reciclagem limitada de componentes avançados, possível lixiviação de materiais perigosos |

Com a procura de IA em forte subida, os operadores de centros de dados substituem o hardware com maior frequência para se manterem competitivos, encurtando a vida útil efetiva destes dispositivos complexos e aumentando a rotação de materiais.

Um ponto muitas vezes esquecido é que a eficiência energética do software não resolve, por si só, o problema do ciclo de vida do equipamento. Se os modelos forem constantemente atualizados para correr em hardware novo, a pressão sobre minas, fábricas e cadeias de abastecimento continua a crescer. Prolongar a utilização dos servidores, modularizar as atualizações e exigir relatórios sobre reparabilidade e reutilização são medidas que podem reduzir parte desta pressão.

Porque é que o MIT diz que ainda estamos a navegar às cegas

Os investigadores do Instituto de Tecnologia de Massachusetts defendem que a sociedade está a subestimar o custo ambiental total da IA, sobretudo porque a tecnologia evolui mais depressa do que os métodos de medição.

Eles apontam vários pontos cegos:

- Os dados de treino e a metodologia raramente são publicados em detalhe, o que dificulta a estimativa do consumo total de energia na formação dos modelos.

- As empresas apresentam muitas vezes as emissões globais de forma agregada, sem separar o que é provocado pela IA.

- As cadeias de abastecimento de chips e servidores são opacas, com poucos dados públicos sobre carbono incorporado e uso de água.

Os cientistas do MIT dizem que faltam métodos “sistemáticos e abrangentes” para acompanhar, em tempo real, as compensações do desenvolvimento acelerado da IA.

Sem melhores dados, os decisores políticos e os planificadores energéticos têm dificuldade em prever quantas novas centrais elétricas, atualizações da rede ou infraestruturas de água serão necessárias para alimentar o crescimento da IA.

Pode a energia limpa salvar a consciência da IA?

As grandes empresas tecnológicas apontam para aquisições agressivas de energia renovável e compromissos de neutralidade carbónica como prova de que a IA pode crescer sem comprometer as metas climáticas. A realidade é mais ambígua.

Muitas empresas compram certificados ou financiam parques eólicos distantes, enquanto continuam a operar centros de dados altamente consumidores de energia em regiões dominadas por combustíveis fósseis. Quando a procura de IA dispara à noite ou durante períodos sem vento e com céu nublado, esses servidores recorrem ao que estiver disponível na rede local nesse momento.

Estão a surgir algumas ideias promissoras: instalar centros de dados perto de recursos hídricos ou geotérmicos, ligá-los a grandes baterias ou programar as execuções de treino para períodos de excedente renovável. Ainda assim, estas abordagens estão longe de ser universais e raramente abordam o uso da água e os impactos do fabrico do hardware.

O que “formação” e “inferência” significam realmente para as emissões

Há dois termos da IA que vale a pena destrinçar, porque estão diretamente ligados ao impacto ambiental.

Formação é a fase única - ou ocasional - em que um modelo aprende a partir de enormes conjuntos de dados. Isto pode demorar semanas em milhares de GPUs, consumindo grandes quantidades de energia e água. Em modelos de fronteira, só a formação pode emitir tanto dióxido de carbono como as emissões totais ao longo da vida de centenas de automóveis.

Inferência é o que acontece sempre que escreve um pedido ou quando uma empresa usa IA sobre dados de clientes. Individualmente, cada interação é pequena. Mas, quando milhões ou milhares de milhões de pedidos são processados diariamente em robôs conversacionais, ferramentas de correio electrónico, motores de pesquisa e telemóveis, o consumo acumulado de energia pode rivalizar com a formação ou até ultrapassá-la.

Se os assistentes de IA se tornarem a interface por defeito para tudo, desde o trabalho de escritório até às recomendações de vídeo e áudio, as emissões da inferência podem tornar-se a parte dominante da pegada da IA.

E se a utilização da IA continuar a duplicar?

Imagine um cenário em que o número de pedidos de IA por pessoa duplica todos os anos durante os próximos três anos, à medida que mais serviços integram ferramentas generativas por omissão:

- Ano um: a IA é usada apenas de forma ocasional, sobretudo por utilizadores mais precoces.

- Ano dois: passa a estar integrada em software de escritório, pesquisa e mensagens; o uso diário torna-se comum.

- Ano três: muitas aplicações executam IA em segundo plano, gerando resumos, alertas e recomendações sem um pedido direto.

Nesse mundo, mesmo que cada resposta da IA se torne ligeiramente mais eficiente, a procura total pode disparar. As redes eléctricas teriam de crescer, novos centros de dados seriam aprovados mais rapidamente e as comunidades locais poderiam enfrentar nova competição por terra e água.

A boa notícia é que aplicações direcionadas de IA podem ajudar as empresas de energia a prever a procura, integrar renováveis e reduzir desperdícios noutros setores. Por exemplo, um controlo mais inteligente do aquecimento, da logística ou de processos industriais pode cortar emissões e compensar parte da pegada da própria IA. O equilíbrio depende das escolhas que estão a ser feitas agora sobre onde a IA é implementada e até que ponto as empresas tecnológicas são transparentes sobre os seus custos reais.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário